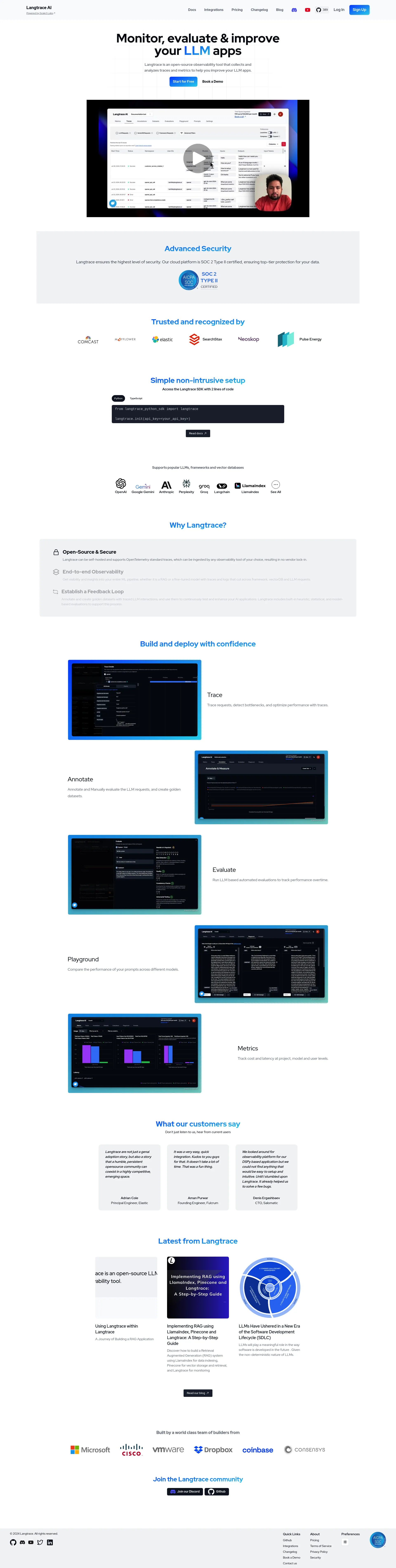

Langtrace AI é um conjunto abrangente de ferramentas para monitorar, avaliar e otimizar modelos de linguagem grandes (LLMs). Ele é projetado para melhorar as aplicações de IA, fornecendo insights em tempo real e métricas de desempenho completas. Como uma ferramenta de observabilidade de código aberto, Langtrace coleta e analisa traços e métricas com o objetivo de melhorar os aplicativos LLM. Capaz de garantir segurança de alto nível, ele é certificado SOC 2 Tipo II para proteção de dados robusta. Um recurso notável do Langtrace é sua configuração simples e não intrusiva, que pode ser acessada por meio de seu kit de desenvolvimento de software (SDK). Langtrace suporta LLMs, frameworks e bancos de dados vetoriais populares, incluindo OpenAI, Google Gemini e Anthropic, entre outros. Seus recursos principais vão desde a observabilidade de ponta a ponta de seu pipeline de aprendizado de máquina, até a criação de conjuntos de dados dourados com interações LLM rastreadas para testes contínuos e aprimoramento de aplicativos de IA. Também facilita a comparação de desempenho em diferentes modelos e o acompanhamento de custos e latência em vários níveis. A natureza impulsionada pela comunidade do Langtrace AI garante a coexistência do espírito de código aberto dentro de um espaço altamente competitivo.

Langtrace é uma ferramenta de observabilidade de código aberto projetada para coletar e analisar traços e métricas, ajudando você a melhorar seus aplicativos LLM (Large Language Model). Impulsionado pela Scale3 Labs, Langtrace oferece segurança avançada e integração perfeita com LLMs, frameworks e bancos de dados vetoriais populares.

Langtrace oferece um modelo de preços flexível para atender às diferentes necessidades. Comece gratuitamente ou reserve uma demonstração para explorar recursos avançados e soluções personalizadas adaptadas aos seus requisitos.

Langtrace é construído por uma equipe de construtores de classe mundial com diversos backgrounds, comprometidos em fornecer ferramentas de observabilidade de primeira linha para aplicativos LLM. Junte-se à comunidade Langtrace no Discord e GitHub para colaborar e se manter atualizado com os últimos desenvolvimentos.

Melhore seus aplicativos LLM com uma ferramenta de observabilidade de código aberto

Condensa texto instantaneamente com a precisão da IA.

Bate-papo com os melhores modelos de IA em uma interface limpa e privada.

A plataforma para enviar agentes LLM confiáveis 10 vezes mais rápido.

Avaliações e observabilidade de código aberto para aplicativos LLM

Plataforma para construir aplicativos de modelo de linguagem grandes

Traduzir texto com precisão nativa

Ajuste fino e avaliação de LLM sem código.

Domine qualquer idioma com aprendizado com IA

Pilha de testes e simulação para sistemas GenAI

Combine-se com profissionais que pensam como você para conversas individuais

Passe do caos do Slack à clareza em minutos

Personalize milhares de páginas de destino em menos de 30 minutos

O primeiro LLM para análise de documentos com precisão e velocidade

Assistentes de IA para profissionais de SaaS

Aplicativo de chamadas telefônicas com tecnologia de IA com tradução ao vivo

Demos interativas cativantes impulsionadas por IA, agora sem necessidade de login

Copiloto de gráficos em movimento com IA

Faça pop em confete para se livrar do estresse e da ansiedade, 100% livre de IA

Pagamentos suaves para SaaS